近日,实验室博士研究生段德鑫同学的论文《Lifelong Test-Time Adaptation via Learning in Tracked Low-Dimensional Subspace》被机器学习和人工智能领域顶级会议Conference on Neural Information Processing Systems(NeurIPS 2025)录用。

NeurIPS作为当前全球最负盛名的机器学习和人工智能领域旗舰会议之一,在谷歌学术发布的全球学术期刊和会议影响力排名中位列第7,H5 index高达337,为中国计算机学会人工智能领域A类国际会议,Core Conference Ranking A*类会议。

文章聚焦终身无监督长期在线适应的退化难题:主流基于熵最小化的方法在持续分布漂移中易陷入“低熵却错误”的陷阱。为此,工作首先识别出熵最小化学习中的关键失败模式——“熵欺骗”样本:模型在此类样本上置信度极高却预测错误,进而在长期适应中诱发崩溃。

文章进而提出了两点关键洞察:(1)“熵欺骗”样本的反向梯度分散且不一致,而“熵真实”样本的梯度高度相关;(2)熵最小化产生的反向梯度天然呈现低维内在结构,且主要由梯度方向更一致的“熵真实”样本所主导驱动。

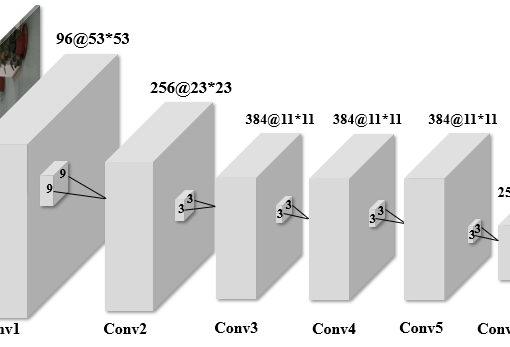

据此,论文提出LCoTTA:在线跟踪少量归一化层的梯度以维护近期梯度队列;利用PCA提取反向梯度队列的主子空间,并将当前梯度投影至该主子空间后再更新,从而在可控计算开销下显著抑制“熵欺骗”样本的有害影响。

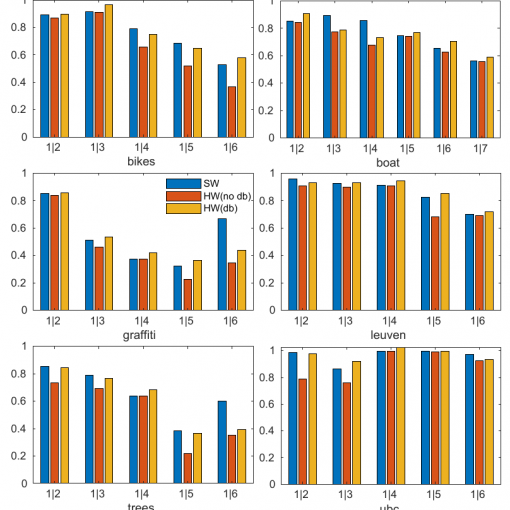

在分类任务上,方法分别于 CIFAR-100C 与更具挑战的大规模数据集 ImageNet-C 上进行评测;在多种模型架构、面对3750万例蚀坏样本的连续适应下取得稳健且优异的长期性能,并显著优于SOTA。该方法同样适用于语义分割任务,在Cityscapes与CARLA仿真数据的不同光照/天气干扰条件下的长期在线适应中亦表现突出。

在理论层面,基于随机微分方程(SDE)的稳定性分析表明:将更新约束于由 ET 样本梯度张成的低维主子空间,可在保证纠偏漂移的同时显著削弱由 ED 引入的偏置与扩散噪声,降低扩散能量,从而扩大稳定收敛区域并提升鲁棒性。

总体而言,LCoTTA首次在无需任何源域信息或模型重置的前提下,实现持续且稳健的长期适应性能,这为理解与解决终身适应学习中的退化问题提供了新视角。会议主席评述:“这项工作在技术上扎实可靠,并且可能在持续与在线适应领域产生重要影响。”